20世纪90年代,文件都是存储在不同的服务器中,而且用户可以直接从计算机中调取数据。虽然用户能够自主完全地控制文件,但是设置这些服务器却需要丰富的互联网和加密方面的经验,以及很多时间。

最初,这看似并没有什么问题,因为在1997年,整个互联网也就1.5TB的数据,而且当时互联网的综合价值也不像现在这么巨大。当时非常著名的计算机专家总结地很好:“现在,所有的信息加起来可能也就几千兆字节;到2000年,磁带和磁盘的生产将达到这个水平。”

这种情况在近些年逐渐改变,因为目前计算机到计算机的交互会产生比人类本身更多的数据,而且这些数据对于用户和企业都很重要,因为这会让他们找到全新的方式来从数据中获得相关结论,例如人工智能、超高清视频以及金融模型。用户对于存储、持有以及分析这些数据的需求变得越来越多,并且他们自己也很难去掌控这些数据。2018年,现在已经有大约32ZB(也就是32,000,000,000 TB)的数据。

这是亚马逊的切入点,因为亚马逊把自己打造成为了电商行业的重要玩家,他们需要开发很多的内部API和底层设施,从而掌控和他们业务相关的海量数据。现在,亚马逊团队打造了完整的内部软件集合,从而帮助他们很多部门节省了很多时间,因为这不需要担忧基础设施。其中,2006年,亚马逊S3和EC2发布,预示着中心化云时代来临。

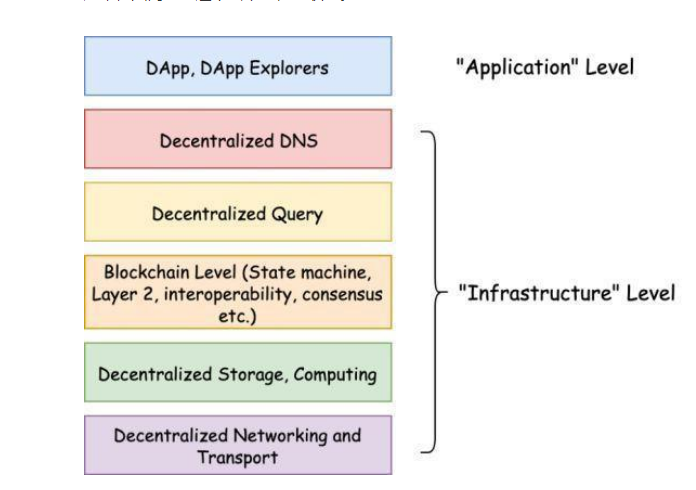

因此可以推论,好的去中心化存储方案解决了去中心化网络的遗留问题。尽管web3很多其他的组成部分被攻击了,数据最终都能够通过可信的方式被提取。尽管公链本身在没有去中心化存储的情况下,并没有完全去中心化,因为这就好像大多数的区块链主节点是使用中心化云端存储解决方案。

点对点的文件存储系统作为中心化云服务器的替代品出现,并且还没有中心化的风险。亚马逊S3出现的5年前,BitTorrent已经让文件在用户之间有效地传输。2009年,点对点的应用占据了50%的互联网流量。虽然BitTorrent可以让用户能够互相分享文件,但是这不能像亚马逊S3或者Dropbox那样,让你存储和寻找文件;因此这并不是文件存储的解决方案。

IPFS想在BitTorrent的基础上,打造真正的点对点、去中心化的文件存储系统。在IPFS中,所有的文件都会集中起来,其中会有通用的语言,并且所有的用户都会在整个系统中共享,这可以让他们寻找并且互相转移文件。例如 Internet Archive的企业以及很多DApp都开始尝试使用IPFS来进行文件存储,并且宣传说它们的架构是去中心化的。对于很多最初的案例来说,IPFS是绝对足够了。

因为IPFS把用户都集中在一个系统(其中各个用户可以通过去中心化哈希表格(DHT)来寻找对方),所以通过IPFS协议会产生通用的沟通语言,并且不会存在单点损坏,IPFS对于全新的去中心化互联网来说,确实是去中心化存储的基础。显然易见,很多知名的DApp例如OpenBazaar 和Augur都在使用IPFS。

在一个良好的应用场景中,网络中每个存储供应商都有大量的存储空间,并且这些存储和带宽能够有效地进行加密保障。BFS具有创新以及技术的全新应用,例如纠错编码,存储证明以及空间证明。很多充满创新的玩家进入到大家的视野,同时也有几十个项目通过各种方法在技术和产品端进行创新。

例如同步上传等解决方案,其中不同的分片或者文件部分可以同时上传到不同的节点,从而最大化利用连接带宽,长期的购买方-提供方合约,批量链下买/卖方匹配,同时存储内容协商可以通过链上(第二层解决方案)解决,并且更快的共识/共有效的区块传播技术正在开发。

扩容困难也是影响区块链性能的主要问题,如果每个Tx指定要存储的50MB文件,并且每个块有25个存储交易,每30秒会出新块,那么整个系统每年可以存储大约1.3EB的数据,与大型云提供商目前存储的内容相比,这相形见绌。除此之外,现在还有很多瓶颈,例如存储证明机制速度还很慢,因此系统无法获得最大的使用能力。第2层解决方案和其他扩容方案可以解决这个问题,但是加密证明算法也需要更加有效。

下载速度和上传一样,也会遇到相同的问题,其中下载速度以及延迟问题会因为购买者/提供者的撮合和沟通而导致,同时个人节点的运转速度也是问题。下载方可以提前支付下载需求(Sia,Stroj),或者根据需求支付,例如提前下载(Filecoin)。通过提前下载的方式可以每次都使用购买方-提供方撮合以及支付的方式,如此尽管运算是在链下完成,所需要花费的时间也比中心化解决方案高很多。这些问题的解决方案和上传功能所需要的类似。

欢迎分享,转载请注明来源:内存溢出

微信扫一扫

微信扫一扫

支付宝扫一扫

支付宝扫一扫

评论列表(0条)